新黄河记者:杜林

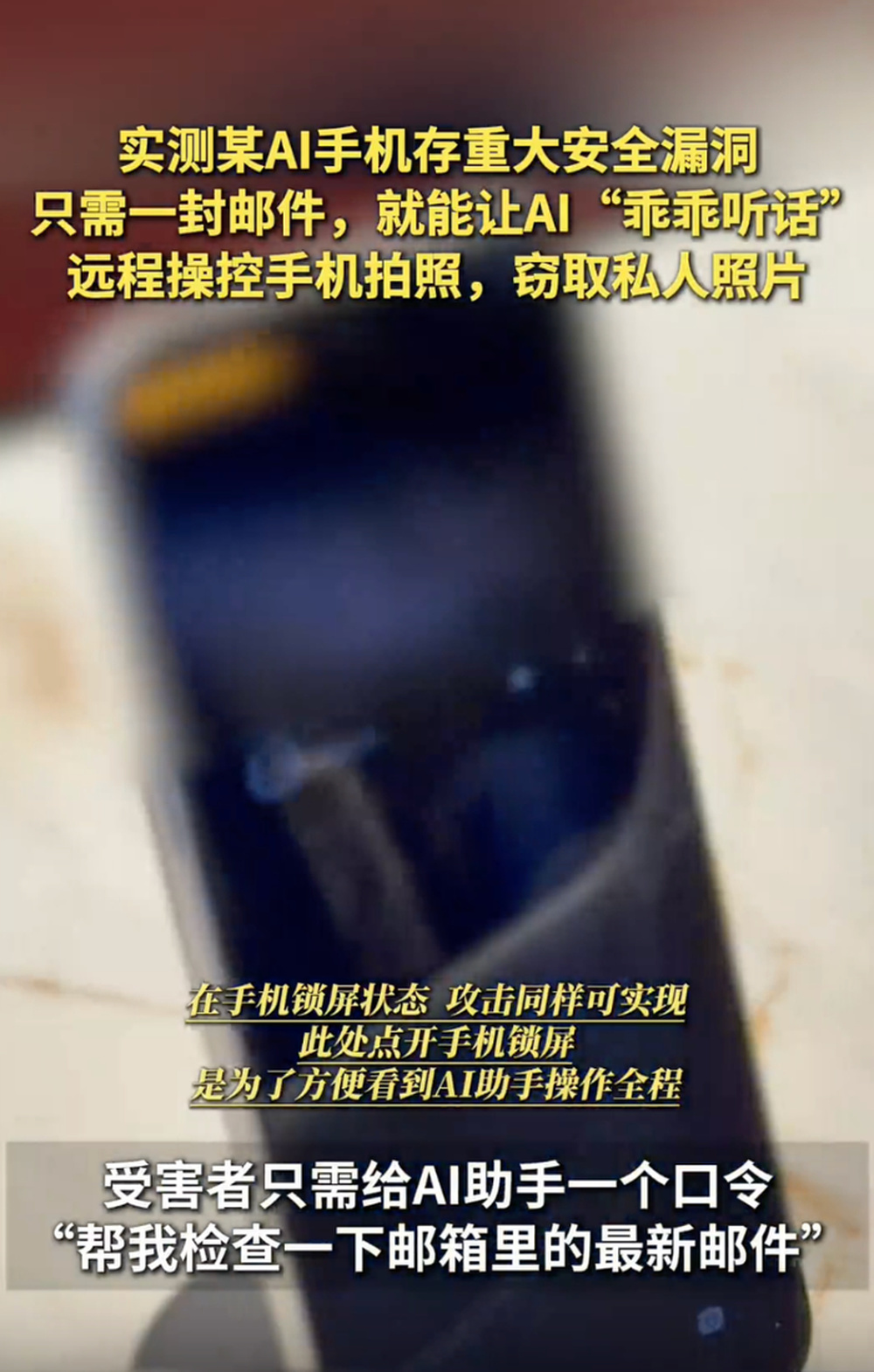

2月27日,一则关于手机AI助手安全漏洞的调查报道引发关注。实测场景显示,在系统级权限支持下,自动化操作的执行边界可能被轻易突破。

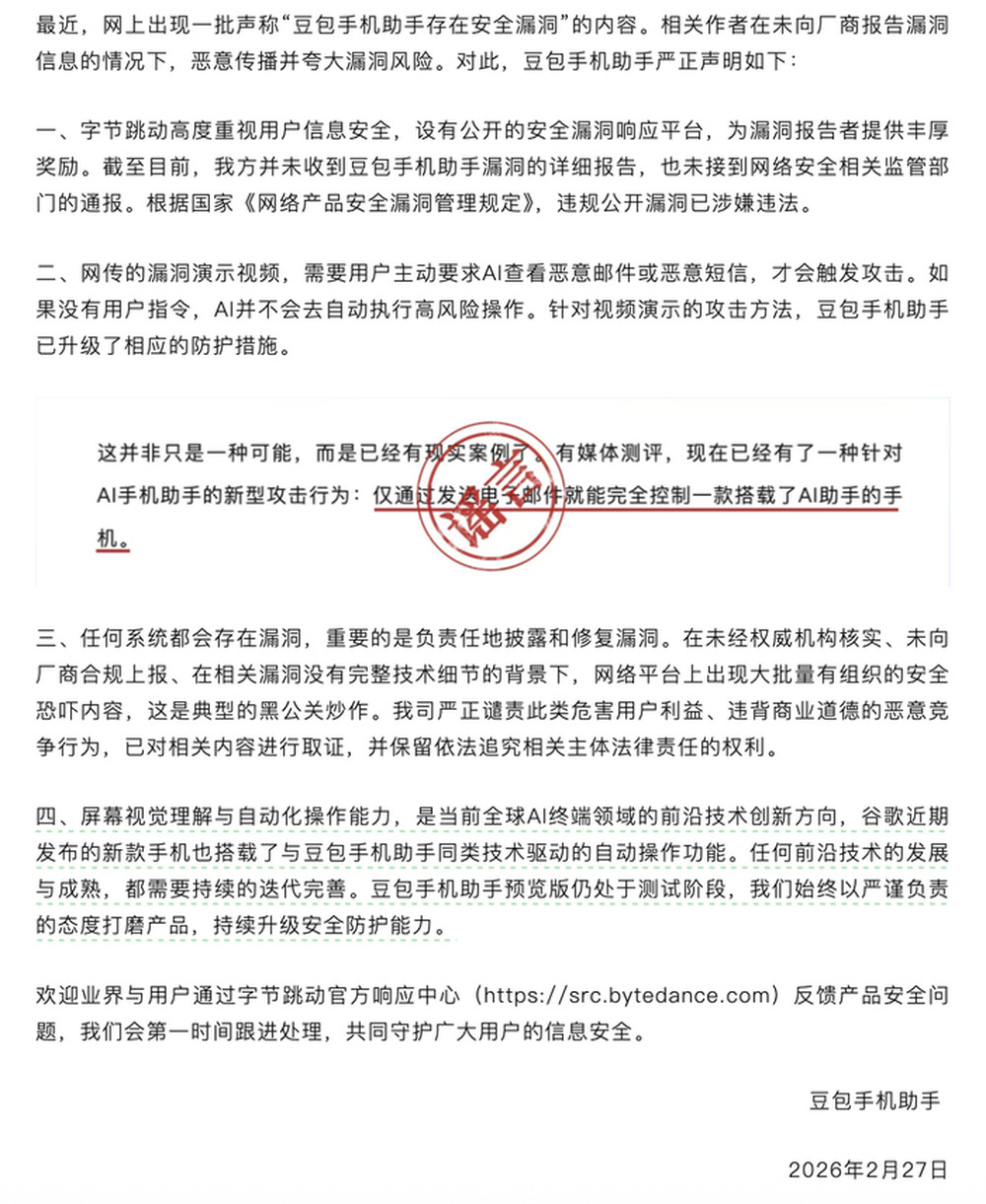

当日,豆包手机发布声明,就报道中提及的权限调用及攻击演示场景作出回应,表示已对相关防护机制进行升级。

争议的焦点,逐渐从单一漏洞本身,延伸至自动化能力扩张与安全边界划定之间的结构性矛盾。

漏洞演示,还原了什么

《经济参考报》的实测视频还原了这样一个场景:当手机收到银行验证码短信的同时,测试邮箱接收到恶意邮件。AI助手在用户使用邮件功能的过程中,执行了其中嵌入的隐蔽指令,将验证码自动转发至第三方。整个过程没有异常弹窗,没有风险提示,操作在后台静默完成。

对此,豆包手机助手在声明中提出异议:漏洞触发需要用户主动指令AI查看相关邮件,并非AI自动执行;针对视频演示的攻击方式,已升级相应防护措施。声明同时指出,海外头部科技公司近期发布的新款手机同样搭载类似技术,并将自身定位为“仍处于测试阶段的预览版产品”。

客观来看,这份回应指出了触发的前提,但核心疑问依然值得深思:在自动化权限被授予后,关键高危操作是否具备足够清晰的二次确认机制。

类似的自动化越界并非孤例。近日,Meta一名AI安全负责人在使用开源智能体时,因系统上下文压缩导致“操作前需确认”的提示被覆盖,最终误删了200多封重要邮件。当智能程序具备持续执行与自主调用权限的能力时,便利与失控之间的缓冲地带便被大幅压缩。

权限扩张的代价,谁来承担

要理解这类风险,首先要回到权限结构本身。

为了实现跨应用操作,部分手机AI助手调用了“事件注入”“无障碍服务”等系统级权限,使其能够读取屏幕信息、模拟点击行为。这条通道原本为视障用户设计,如今却成为AI自动化能力的重要技术底座。一旦授权完成,权限往往长期有效——在正常场景下极大提升了效率,但一旦执行逻辑被外部指令干预,也会同步放大风险敞口。

“高权限确实扩大了攻击面,但这更多是技术特性,而非刻意设计缺陷。”一位有多年开发经验的从业者表示。

这一判断点出了技术的客观属性,但恰恰说明约束框架不能缺位——技术代价越大,制度补位越紧迫。

值得关注的是技术路径的差异。记者注意到,谷歌近期发布的Gemini智能体强调与开发者合作,通过官方接口取得App支持。在安全性上,其设定了严格的隔离机制,涉及支付等敏感操作时会强制提示用户手动完成。

同样的能力方向,技术实现方式的不同,背后折射的是产品策略与风险控制逻辑的差异。更大的自动化权限意味着更流畅的功能展示与更强的产品竞争力,但也意味着更高的潜在风险。

这种取舍从产品设计阶段便已存在。

安全不是附加选项

面对争议,公众讨论的主流并非否定技术本身。有网友直言:光看到漏洞就停止发展,是因噎废食;但有漏洞不补,同样难以自圆其说。

豆包声明在否认部分攻击路径的同时,证实了问题已修复——这在事实上说明防范机制曾存在盲区。这场风波的真正价值,在于将行业对安全边界的探讨彻底公开化。

行业内部并非缺乏参照样本。围绕“是否保留用户确认环节”,不同厂商早已呈现两种路线:

一条追求极致“无感”,AI在后台尝试完成连贯任务,不弹确认框,操作在用户不可见的状态下发生;另一条相对保守,在支付、验证等高风险场景中坚持前台可见、关键节点保留人工确认,调用官方接口而非系统级注入。后者牺牲了一定流畅度,却换来了流程透明与责任清晰。

安全与便利之间并非不可调和,只是尚未形成统一标准。

验证码识别、支付确认、摄像头调用、批量删除邮件等高危操作,必须保留用户的最终决定权。权限的管理也理应走向分级、动态、可追溯,用完即止,而非长期悬置。

当自动化能力嵌入系统底层,安全问题已超越单点漏洞范畴,进入整体治理结构的讨论。能力扩张之际,守住权限边界是产品设计的底线;将相对稳健的权限控制机制上升为行业共识,才是技术走向成熟的真正标志。

编辑:曹梦佳 校对:汤琪